codage de shannon-fano pdf

|

Algorithmes de Shannon

A chaque lettre correspond un unique mot de code (ex : A ↔ 01) L'ensemble des mots de code constitue un dictionnaire ▫ La séquence de bits ainsi produite |

|

Chapitre 12 Théorie de linformation et Codage

La méthode de Fano fournit un codage binaire instantané (i e décodable à la volée) Elle est proche de la méthode de Huffman utilisée dans les compressions |

|

Chapitre 3: Codage de Sources Discrètes et Compression

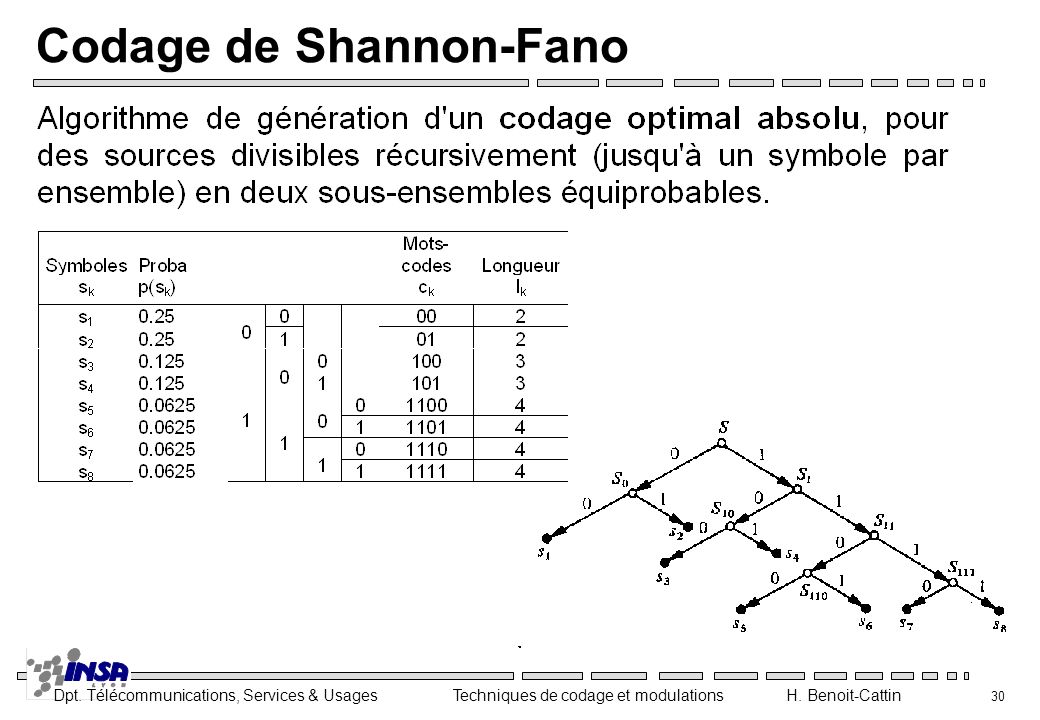

Le code de Shannon-Fano est le premier code à avoir exploité la redondance d'une source: 1 Ranger les symboles de A par probabilités décroissantes 2 |

|

Codage de Source

Codage de Shannon-Fano Codage de Huffman 1 Cours n° 7 Page 2 Problème Probabilités Code A Code B Code C Code D Code E Code F 04 0 00 0 0 0 |

|

Cours 6

Premier théor`eme de Shannon Premi`ere version Deuxi`eme version Quelques codes courants Code de Shannon-Fano Code de Huffman Laurent Oudre Théorie de l |

|

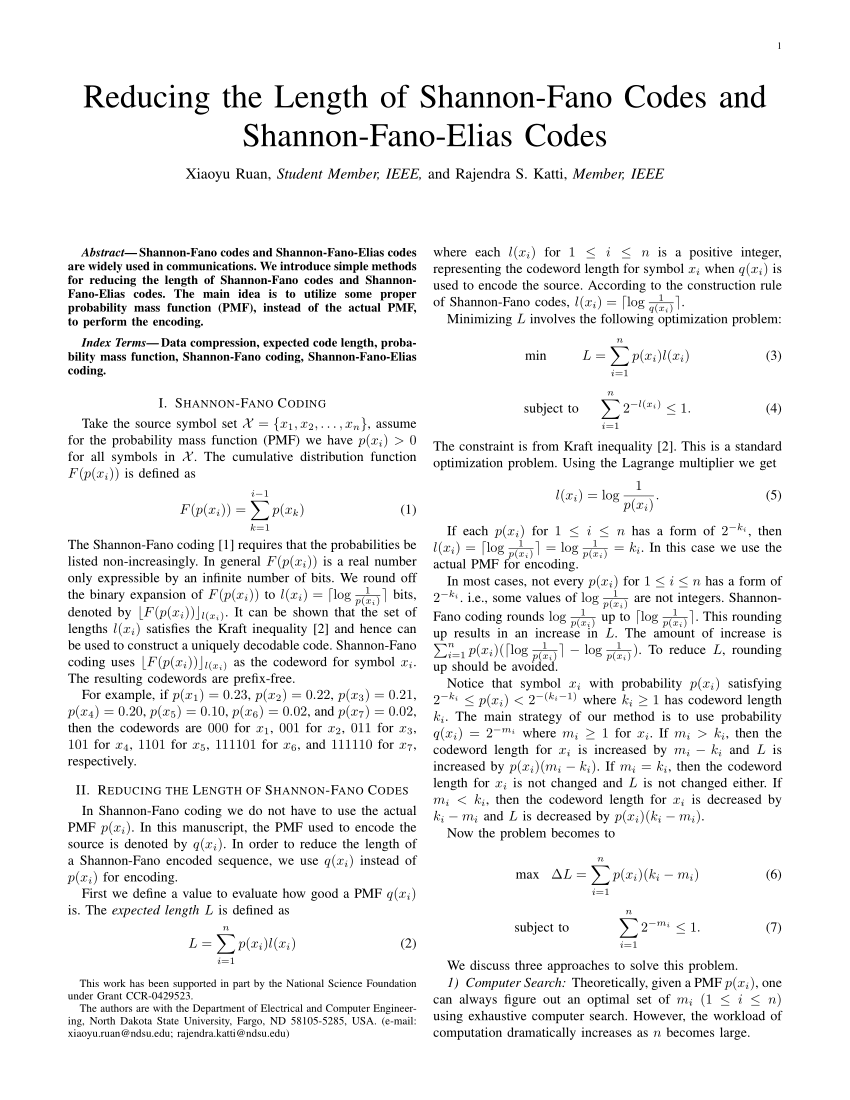

Cours/TD 5 Codage Shannon Codage arithmétique : Elias

Cours/TD 5 Codage Shannon Codage arithmétique : Elias 5 1 De l'algorithme de Fano et Shannon au codage arithméthique Si N-1 ∑ j=0 2-lj < 1 l'inégalité de |

|

Jijel

Le codage de Shannon-Fano techniques de codage telles que Shannon-Fano Huffman etc II 3 Les différentes méthodes de compression sans perte II 3 1 Le |

|

Notes de cours Codage de Huffman

Code développé en 1960 par Claude E Shannon (MIT) et Robert M Fano (Laboratoires de Bell) • Assignation du code selon la probabilité de chaque symbole |

|

Techniques de codage et de compression

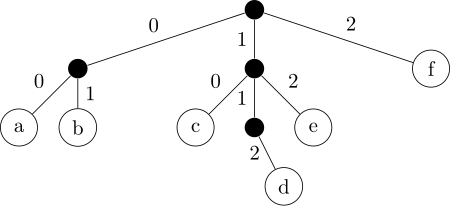

Codage de Fano-Shannon Il s'agit de construire un arbre en équilibrant à chaque fois au maximum les sous-arbres droit et gauche 2 4 1 Donner un code |

|

Théorie et codage de linformation

Le code de Shannon-Fano est le premier code à avoir exploité la redondance d'une source On en expose à présent le principe 1 Ranger les états du système par |

|

Lecture 10: Shannon-Fano-Elias Code Arithmetic Code

Arithmetic Code. • Shannon-Fano-Elias coding. • Arithmetic code. • Competitive optimality of Shannon code. • Generation of random variables. |

|

Example 1

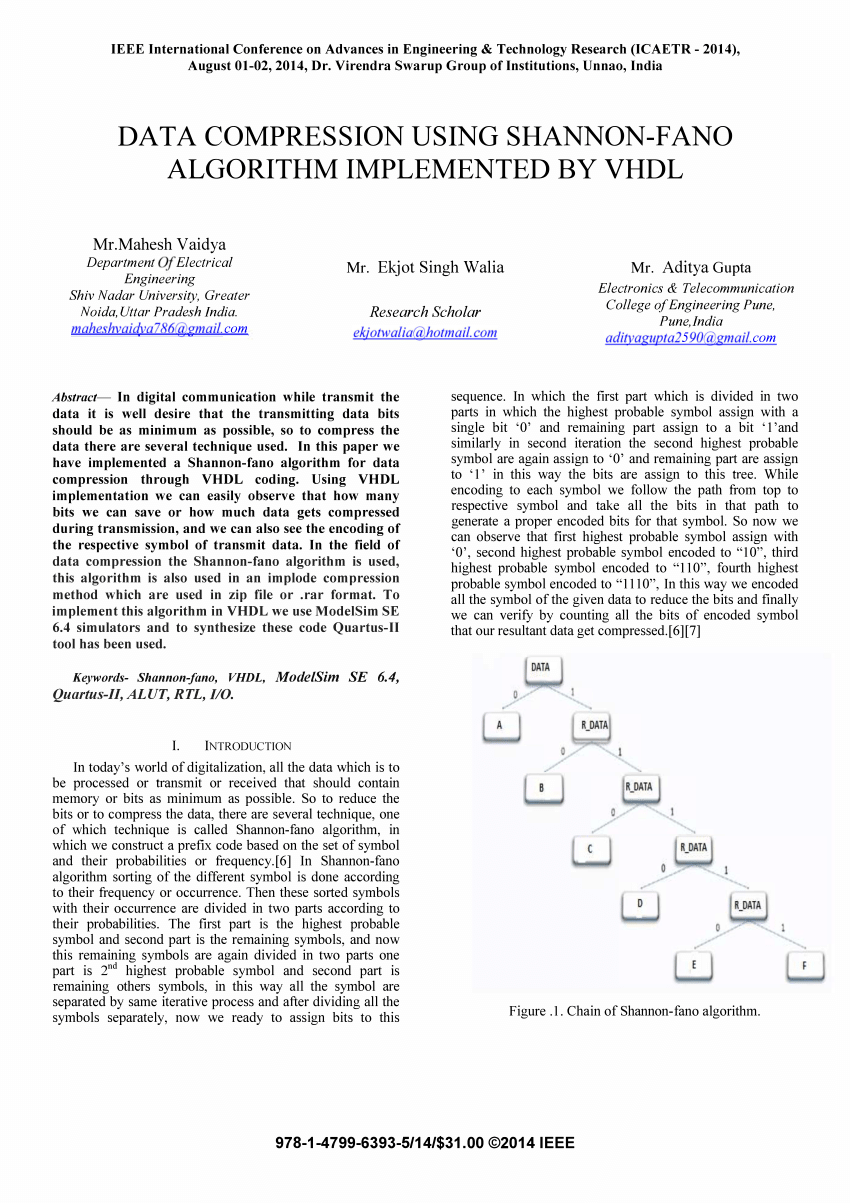

2. Shannon-Fano coding: X. P(X). I (bits) steps code code word length: d = 0.4 · 1+0.3 · 2+0.15 · 3+0.1 · 4+0.05 · 5=2.1 [bits/symbol]. Data rate:. |

|

Shannon – Fano Code

Shannon–Fano coding named after Claude Elwood Shannon and Robert Fano |

|

1 Entropy

The Shannon-Fano code is pretty decent: Question: What can you say about the expected number of bits used to encode one (random) symbol? Answer: By |

|

Source Coding techniques: 1- Shannon – Fano Code Shannon

Shannon–Fano coding named after Claude Elwood Shannon and Robert Fano |

|

15 pt Kraft Inequality and Shannon-Fano Codes

Aug 13 2012 Theorem: Suppose that C is a prefix code and TA has D letters. Then. ? x?SA. D. ?l(x) ? 1. (?) where l(x) = length of codeword C(x). |

|

ECE 587 / STA 563: Lecture 5 – Lossless Compression Outline of

Sep 3 2020 A source code is a mapping C from a source alphabet X to D-ary ... as the Shannon–Fano–Elias Code. ... Portable Document Format (PDF). |

|

Data Compression

Shannon-Fano-Elias Codes index inside class ? fixed-length code with K+p bits ... code C aaaa. 0 aaab. 10 aab. 110 ab. 1110 b. 1111 suitable code D. |

|

Lecture 7: Source Coding and Kraft Inequality

set of finite-length strings of symbol from D-ary alphabet D Expected length L(C) of a source code C(x) for X with pdf p(x) ... Shannon-Fano coding. |

|

Cours/TD 5 Codage Shannon Codage arithmétique : Elias

Cours/TD 5 Codage Shannon Codage arithmétique : Elias 5 1 De l'algorithme de Fano et Shannon au codage arithméthique Si N-1 |

|

Cours/TD 2 Codage ”proche de lentropie”

Idée naturelle (Shannon et Fano) : associer aux symboles de notre alphabet des mots code binaires dont la longueur est égale au contenu d'information des |

|

Théorie de linformation - Chap 1: Codage Source - Esentn

Algorithme de Huffman 6 Algorithme de Fano-Shannon 7 Limitations de Fano-Shannon et Huffman et Supériorité de LZW 8 Code par répétition |

|

Codage entropique - CU-ELBAYADHDZ

Le codage de Shannon-Fano est la première méthode de codage entropique efficace développée en même temps par Claude Shannon et Robert Fano en 1949 Cette |

|

Notes de cours Codage de Huffman

Code développé en 1960 par Claude E Shannon (MIT) et Robert M Fano (Laboratoires de Bell) • Assignation du code selon la probabilité de chaque symbole |

|

Techniques de codage et de compression

1 2 1 Quels sont les symboles de code ? Quelle est la valence du codage ? Chaque symbole de code CODAGES COMPRESSIFS : SHANNON FANO-SHANNON ET HUFFMAN |

|

Introduction au codage source - Laurent Oudre

Exercice 1 : Codes non singuliers déchiffrables et instantanés 1 Construire le code de Shannon-Fano associé `a la variable aléatoire X et calculer la |

|

Cours 6 - Introduction au codage source - Laurent Oudre

Master Ingénierie et Innovations en Images et Réseaux - 1`ere année 2017-2018 Code de Shannon-Fano exemple au début de la création du format ZIP) |

|

Information Calcul et Communication Module 2 - Moodle EPFL

compression optimale : code de Huffman ? compression avec pertes Shannon-Fano (bis) Th de Shannon Codes de Huffman Compression avec pertes Conclusion 1 |

|

Codage de Source - Cédric Richard

Codage de source Digital Communications B Sklar Prentice Hall 1 Modèle de communication : le paradigme de Shannon Code de Shannon-Fano |

|

Principes généraux de codage entropique dune sourcepdf

abordées notamment les méthodes d'ordre zéro, non-adaptatives à savoir : l' algorithme de codage de Shannon-Fano l'algorithme de codage de Huffman |

|

Code de Huffman

IFT-4003/7023 Compression de données Mohamed Haj Taieb, Département de génie électrique et de génie informatique Exemple: codage de Shannon-Fano |

|

Cours/TD 5 Codage Shannon Codage arithmétique : Elias

Idée naturelle (Shannon et Fano) était d'associer aux symboles de notre alpha- bet des mots code binaires dont la longueur est égale au contenu d'information |

|

Codage statistique

Codage statistique optimal • Codes de Fano - Shannon • Codes arithmétiques ( codage en bloc, de type codage d'intervalles) possibilités d'adaptation en ligne |

|

UV Théorie de lInformation Cours n° 5 : Compression de l - ASI

i e codage de Shannon−Fano, codage de Huffman, codage comparé au Code de Shannon−Fano, gain en compression fichiers au format PDF ; |

|

Série dexercices sur la compression de données 1 Algorithme de

Une fois l'arbre des questions construit, procéder comme pour le code de Shannon-Fano en décidant d'affecter le symbole 0 `a toutes les réponses non et le |

|

Théorie de linformation - Chap 1: Codage Source - ESEN

Limitations de Fano-Shannon et Huffman et Supériorité de LZW 8 Code par généralement codé sous forme d'autres séquences de symboles adaptés au canal de sont: gif (compression d'images), tiff, png, pdf , zip (Winzip), gzip, pkzip , |

|

Etude, implémentation et optimisation dun algorithme de

4 jan 2020 · 3 12 Exemple du code de Shannon-Fano-Elias On se rend compte que la fonction de distribution ( pdf ) de l'erreur de prédiction e(n) = x(n)− |

|

Information & Entropie - efreidocfr

Le codage réalisé c'est celui de Shannon-Fano Calculer la longueur moyenne du code par symbole dans le cas de chaque extension, que peut-on en déduire? |

|

A la théorie de linformation TD 6 : Introduction au codage source

Exercice 3 : Codage de Shannon-Fano, codage de Huffman Soit X une source ` a valeurs dans 1A, E, G, I, Ll o`u les probabilités d'apparition des symboles sont |