Introduction aux Méthodes d`Optimisation sans Gradient pour l

|

Introduction aux Méthodes dOptimisation sans Gradient pour l

Les algorithmes génétiques diffèrent des autres méthodes d'optimisation car ils utilisent un codage des variables de contrôle plutôt que les variables de |

|

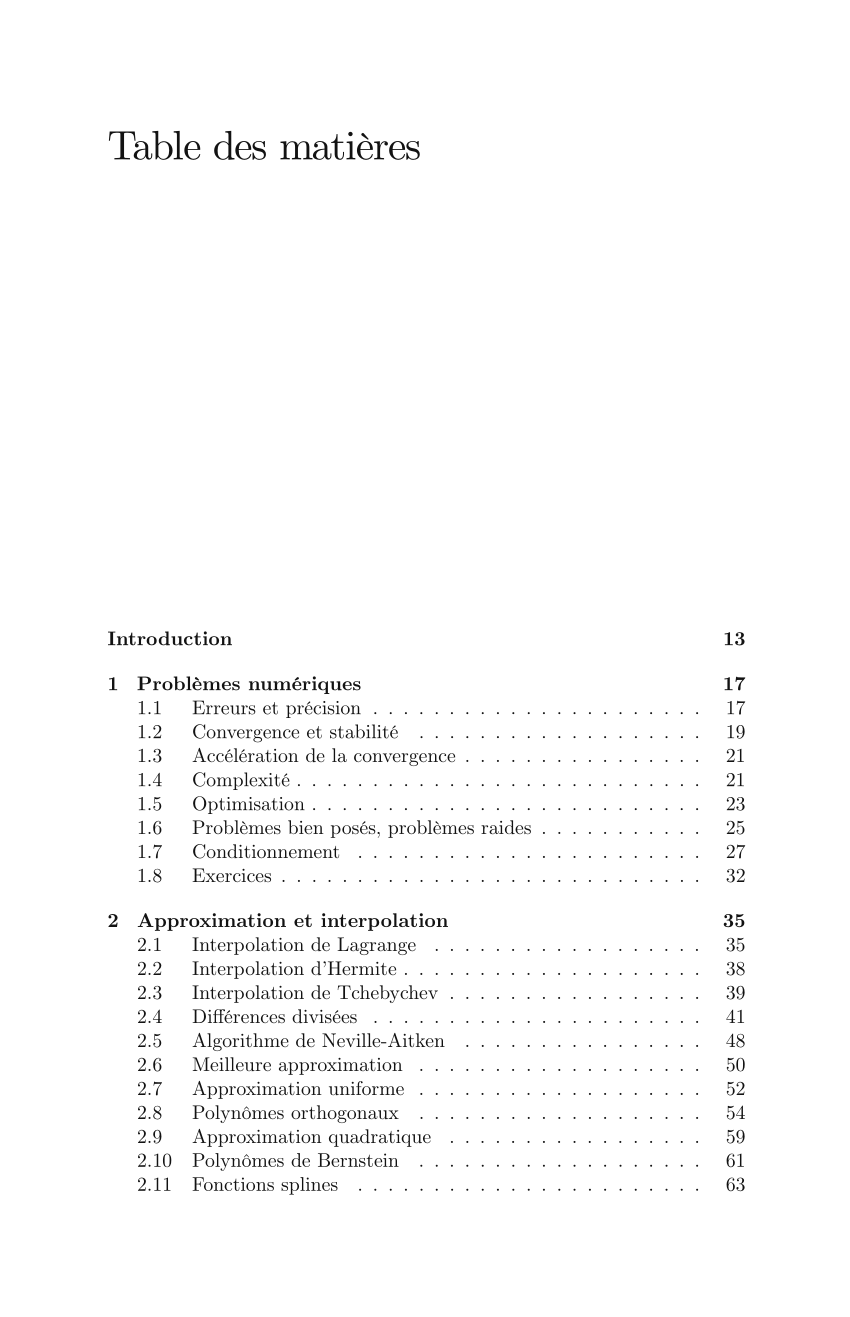

Introduction à loptimisation aspects théoriques et numériques

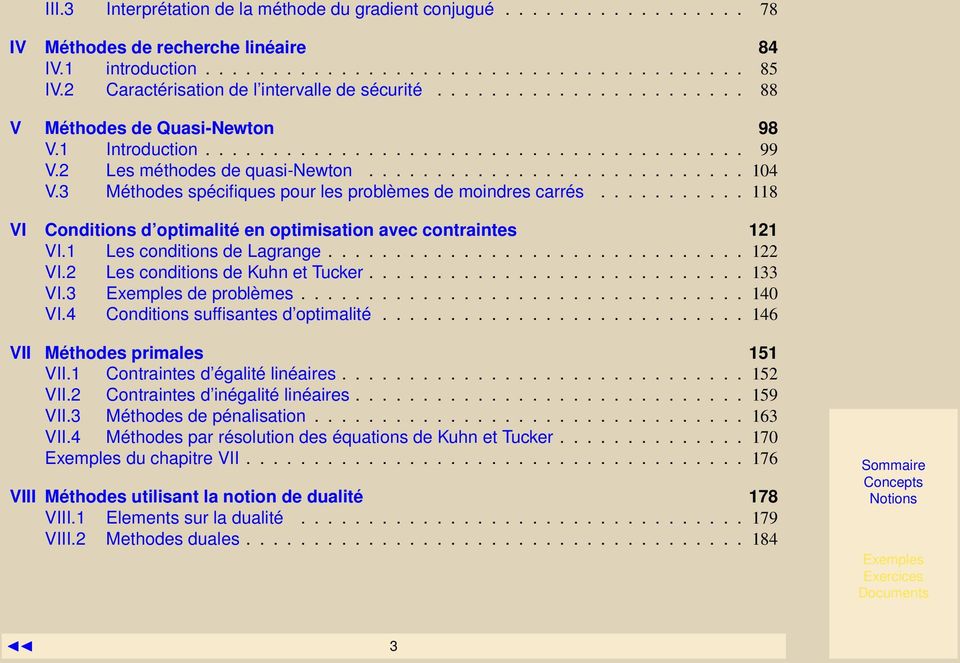

Méthodes de type gradient. 2. Algorithmes pour l'optimisation SANS contrainte. Les méthodes de Newton en dimension supérieure. 3. Introduction `a |

|

Introduction à lOptimisation Numérique

2.3.1 Algorithmes de gradient à pas fixe/pas optimal . solution de problèmes d'optimisation sans contrainte (cf chapitre 2) puis avec contraintes (cf. |

|

Introduction à loptimisation Aspects théoriques et numériques

III.3 Méthodes de gradient . III.4 Les méthodes de Newton et quasi-Newton . ... Si K = V on dit que (I.1) est un problème d'optimisation sans ... |

|

Méthodes Numériques : Optimisation

La première et principale partie du cours concerne les problèmes d'optimisation sans contraintes. Nous abordons les algorithmes de type descente de gradient |

|

Introduction à loptimisation Aspects théoriques et numériques

III.3 Méthodes de gradient . III.4 Les méthodes de Newton et quasi-Newton . ... Si K = V on dit que (I.1) est un problème d'optimisation sans ... |

|

Introduction à lOptimisation Numérique

Ces informations sont fournies en “boite noire” i.e. par un sous-programme indépendant de l'algorithme d'optimisation choisi : routine de calcul du gradient |

|

Comparaison de différentes méthodes doptimisation sans

Dans ce TP d'introduction `a l'optimisation pour l'image nous allons introduire un gradient comment chercher le minimum d'une fonction par descente de ... |

|

Méthodes numériques : optimisation

Apr 19 2015 chapitre portera sur les méthodes de gradient conjugué |

|

Notes de cours - Préparation à lagrégation - Introduction à l

3 Conditions d'optimalité - optimisation sans contrainte L'interpolation de Lagrange et les algorithmes de gradients seront étudiés ultérieurement au. |

|

Introduction aux Méthodes dOptimisation sans Gradient pour l - Inria

Introduction aux Méthodes d'Optimisation sans Gradient pour l'Optimisation et le Contrôle en Mécanique des Fluides R Duvigneau |

|

Méthodes doptimisation sans gradient pour des probl`emes

18 avr 2013 · Méthodes d'optimisation sans gradient pour des probl`emes inverses en ingénierie pétroli`ere Laurent DUMAS avec F Delbos D Ding (IFPEN) |

|

Introduction à lOptimisation Numérique

Dans les chapitres suivants nous entrons dans le vif du sujet en nous intéressant à la ré- solution de problèmes d'optimisation sans contrainte (cf chapitre 2) |

|

Cours-Optimisationpdf

L'optimisation consiste en la recherche du minimum (ou du maximum) d'une cer- taine quantité appelée coût ou objectif Dans ce cours on supposera que le |

|

Méthodes Numériques : Optimisation - ceremade

La première et principale partie du cours concerne les problèmes d'optimisation sans contraintes Nous abordons les algorithmes de type descente de gradient |

|

Méthodes numériques : optimisation - ceremade

19 avr 2015 · chapitre portera sur les méthodes de gradient conjugué et s'il reste un pour résoudre des problèmes d'optimisation avec contraintes |

|

Optimisationpdf

Plan du cours • Introduction • Analyse de la fonction objectif • Conditions d'optimalité sans contrainte • Résolution d'équations • Optimisation sans |

|

Aspects théoriques numériques et algorithmes

1 3 6 Le gradient d'un champ scalaire 4 Quelques algorithmes pour l'optimisation sans contraintes 4 6 Les méthodes de Newton et quasi-Newton |

|

Introduction à loptimisation Aspects théoriques et numériques

Même pour le gradient à pas optimal qui est en principe la meilleure de ces méthodes d'un point de vue de la rapidité de convergence celle-ci peut être lente |

|

Résumé dOptimisation

Et donc le gradient de f en uk+1 lui est orthogonal 5 2 Méthode de Newton Si f est une fonction réguli`ere dont on sait calculer le gradient et la matrice |

|

Introduction aux Méthodes dOptimisation sans Gradient pour l - Inria

L'algorithme débute par le choix d'un codage permettant de représenter les variables du problème d'optimisation par une structure génétique Une population |

|

Introduction à loptimisation Aspects théoriques et numériques

III 3 Méthodes de gradient III 4 Les méthodes de Newton et quasi-Newton Si K = V , on dit que (I 1) est un problème d'optimisation sans contrainte |

|

Introduction à lOptimisation Numérique - Sébastien Tordeux

2 4 1 Algorithmes de gradient à pas fixe/pas optimal ce cours) : ce sont les paramètres sur lesquels l'utilisateur peut agir pour faire évoluer le tion de problèmes d'optimisation sans contrainte (cf chapitre 2), puis avec contraintes (cf |

|

Résumé dOptimisation

5 1 2 Méthode de la plus profonde descente (méthode du gradient) Ceci un résumé des principaux résultats du cours d'optimisation le cas pour les probl` emes sans contrainte, et que si la ou les solutions sont sur le bord, il y a, comme |

|

Introduction `a loptimisation : aspects théoriques, numériques et

1 3 6 Le gradient d'un champ scalaire 4 Quelques algorithmes pour l' optimisation sans contraintes 47 4 6 Les méthodes de Newton et quasi- Newton |

|

Méthodes numériques : optimisation - Ceremade

19 avr 2015 · chapitre portera sur les méthodes de gradient conjugué, et s'il reste un le cas de convergence d'ordre β avec β > 1, le nombre de décimales |

|

Méthodes Numériques : Optimisation - Ceremade - Université Paris

7 3 1 Optimisation quadratique sous contraintes d'égalités linéaires Nous abordons les algorithmes de type descente de gradient, la méthode du gradient |

|

COURS OPTIMISATION Cours à lISFA, en M1SAF Ionel Sorin

3 2 1 Méthodes de gradient à pas optimal 4 2 Optimisation sous contraintes d' inégalités Les méthodes de gradient sont définis alors par les relations : |

|

2 Optimisation sans contraintes

Les contraintes inégalité inactives n'ont pas d'influence sur la solution x* du problème (PO) On peut les (dérivée directionnelle = produit scalaire avec le gradient) Fonction Méthode de mise à l'échelle : transformation affine X' = αX + β |

|

Méthodes numériques pour loptimisation Méthode de gradient (1

de gradient (1) Probl`eme d'optimisation sans contrainte inf Méthode du gradient conjugué : tr`es efficace pour les syst`emes SDP (vk est minimiseur de J |