7 Lois de probabilité

7 Lois de probabilité

calculer des probabilités sur la loi exponentielle On sait que (x ? 80) /12 sera une valeur négative puisque la probabilité demandée est.

Relations entre quelques lois de probabilités

Relations entre quelques lois de probabilités

liaison entre la loi binomiale et la loi binomiale négative. On particulier pour la loi normale

Actuariat IARD - ACT2040 Partie 4 - modèles linéaires généralisés

Actuariat IARD - ACT2040 Partie 4 - modèles linéaires généralisés

Exemple La loi Binomiale Négative de paramètres r et p

Surdispersion et modèle binomial négatif généralisé

Surdispersion et modèle binomial négatif généralisé

variable aléatoire X à valeurs dans N suit une loi binomiale négative une loi exponentielle de dispersion de paramètres 03B8 et 03BB (notée X ~ ED (0 ...

FIABILITE MAINTENABILITE DISPONIBILITE

FIABILITE MAINTENABILITE DISPONIBILITE

Le choix de la loi exponentielle dont la propriété La loi binomiale négative est la loi de probabilité de la variable aléatoire X qui comptabilise le.

Annexe A

Annexe A

la loi exponentielle est un cas particulier de la loi gamma (avec si r E N+ la distribution binomiale negative est parfois appelee.

4 Lois a priori

4 Lois a priori

Dans le cas d'une loi binomiale négative de paramètre (n p)

Marche aléatoire dont la répartition de la longueur des étapes suit

Marche aléatoire dont la répartition de la longueur des étapes suit

(i) la longueur s de chaque étape suit la loi exponentielle négative. . (ii) parvenu au point terminant une étape

Chapitre 3 - Principales distributions de probabilités

Chapitre 3 - Principales distributions de probabilités

Définition 10 La loi exponentielle de param`etre ? décrit la distribution d'une variable continue X qui ne prend que des valeurs positives selon la fonction de.

Regression avancée Chapitre 2 : la famille exponentielle et le

Regression avancée Chapitre 2 : la famille exponentielle et le

Loi normale (à densité par rapport à la mesure de Lebesgue sur R). N(µ 1) avec µ ? R. 1. ?. 2? exp(?. 1. 2. (y ? µ). 2. ) sur R. ? Loi exponentielle

[PDF] 1 Rappels sur la loi exponentielle

[PDF] 1 Rappels sur la loi exponentielle

Une propriété caractéristique de la loi exponentielle est la propriété dite « d'absence de mémoire » Lemme 1 : Soit X une v a à valeurs dans R+ de fonction

[PDF] Terminale S - Loi uniforme Loi exponentielle - Parfenoff org

[PDF] Terminale S - Loi uniforme Loi exponentielle - Parfenoff org

Loi uniforme Loi exponentielle I) Loi uniforme de probabilité sur [a : b] La loi de probabilité qui admet pour densité la fonction constante

[PDF] MODULE 7 LOIS PROBABILITÉ PROBABILITÉ - Université du Québec

[PDF] MODULE 7 LOIS PROBABILITÉ PROBABILITÉ - Université du Québec

La loi exponentielle donne le temps d'attente avant un événement lorsque le processus est régi par une loi de Poisson Dans le cas de la loi de Poisson la

[PDF] loi exponentielle exercices corriges - Maurimath

[PDF] loi exponentielle exercices corriges - Maurimath

LOIS EXPONENTIELLES - EXERCICES Exercice n°1 (correction) La durée de vie en heures d'un composant électronique est modélisée par la loi exponentielle

[PDF] Fonctions génératrices

[PDF] Fonctions génératrices

Soit X ; E(?) une v a suivant une loi exponentielle Son k-i`eme moment µX (k) := EXk se calcule facilement au moyen de k intégrations par parties et est

[PDF] LOIS DE PROBABILITÉ USUELLES

[PDF] LOIS DE PROBABILITÉ USUELLES

La somme de deux v a indépendantes suivant les lois binomiales négatives de La somme de n v a indépendantes suivant la loi exponentielle E(?) suit la

[PDF] Chapitre 13 : Intégration et loi exponentielle

[PDF] Chapitre 13 : Intégration et loi exponentielle

En mathématiques l'intégration est le fait de calculer une intégrale C'est aussi une des deux branches du calcul infinitésimal appelée également calcul

[PDF] Loi exponentielle et processus de Poisson homogéne

[PDF] Loi exponentielle et processus de Poisson homogéne

1 1 Notions sur la loi exponentielle et la loi de Poisson paramètre ? > 0 et on note X ' 2(?) si elle prend des valeurs entières non#négatives

Loi exponentielle - Wikipédia

Loi exponentielle - Wikipédia

Une loi exponentielle modélise la durée de vie d'un phénomène sans mémoire ou sans vieillissement ou sans usure : la probabilité que le phénomène dure au

[PDF] Lois de probabilité - LAMA - Univ Savoie

[PDF] Lois de probabilité - LAMA - Univ Savoie

Loi binomiale négative B?(n p) n ? 1 0 0 : pour k ? N

M1 ISDStatistique Bayésienne

Cours 3

4 Lois a priori

Le choix des lois a priori est une étape fondamentale dans l"analyse bayésienne. Ce choixpeut avoir différentes motivations. Les stratégies sont diverses. Elle peuvent se baser sur des

expériences du passé ou sur un intuition, une idée que le particien a du phénomène aléatoire

qu"il est en train de suivre. Elles peuvent être également motivées par des aspects calculabilité .

Enfin, ces stratégies peuvent également tenir compte du fait qu"on ne sait rien par le truchement

des lois non informatives.4.1 Lois conjuguées

Une des difficultés de l"approche bayésienne est le calcul de la loi a posteriori. Ce calcul est

facilité lorsque loi a priori et loi a posteriori ont lamême forme. Dans ce cas, on parle de loi a

priori conjuguée. Définition 9- Une familleFde lois surΘest dite conjuguée si, pour toutπappartenant à cette famille, la loiπ(θ/x)appartient également à celle-ci.Dans ce cas, le praticien induit directement la forme de son estimateur dès qu"il a choisi sa loi a

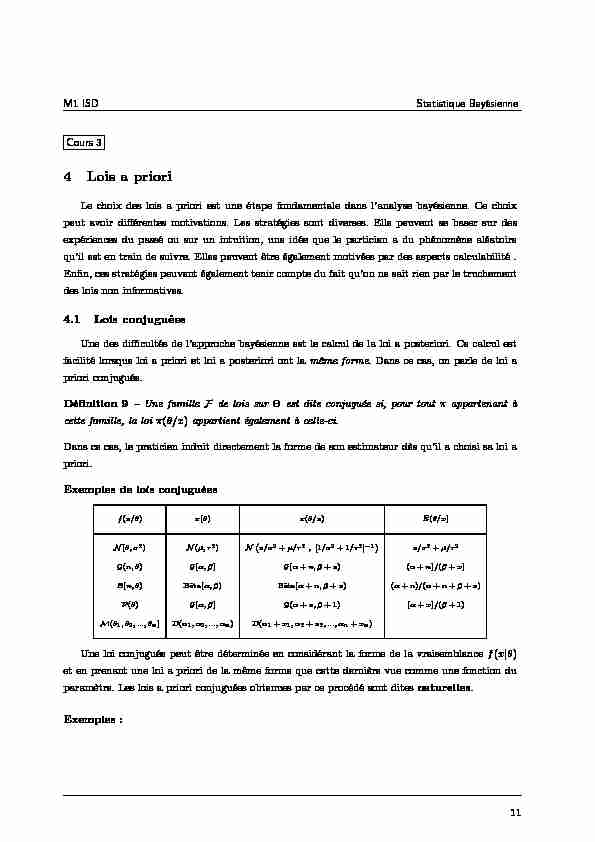

priori.Exemples de lois conjuguées

f(x/θ)π(θ)π(θ/x)E(θ/x) N(θ,σ2)N(μ,τ2)N?x/σ2+μ/τ2,[1/σ2+ 1/τ2]-1?x/σ2+μ/τ2 P(θ)G(α,β)G(α+x,β+ 1)(α+x)/(β+ 1)Une loi conjuguée peut être déterminée en considérant la forme de la vraisemblancef(x|θ)

et en prenant une loi a priori de la même forme que cette dernière vue comme une fonction du paramètre. Les lois a priori conjuguées obtenues par ce procédé sont ditesnaturelles.Exemples :

11M1 ISDStatistique Bayésienne

•Considérons une loi Pareto de paramètres(α,a). f(x|θ,a) =θaθ xθ+11[a,+∞[(x). Supposonsaconnu,f(x|θ)?θeθlog(a/x), on pourrait donc prendre une loi a priori de type gamma. •Dans le cas d"une loi binomiale négative de paramètre(n,p),P(X=x|p) =Cxn+x-1px(1-p)n,0< p <1, x?N.

On voit clairement qu"une loi naturelle conjuguée sera une loi bêta puisque :P(X=x| p)?px(1-p)n.Etudions maintenant en détail le cas d"une famille de lois très importante : la famille des lois

exponentielles.4.2 Cas du modèle exponentiel

On rappelle tout d"abord la définition du modèle exponentielle.Définition 10On appelle famille exponentielle às-paramètres, toute famille de loi de distribu-

tion{Pθ}dont la densité a la forme suivante : f(x|θ) = exp? s? i=1η i(θ)Ti(x)-B(θ)? h(x)(2) oùηi(.)etB(.)sont des fonctions du paramètreθetTi(.)sont des statistiques.Exemples :

•Loi exponentielle : f(x|θ) =1θe-x/θ1[0,+∞[(x)

= exp -1θx-logθ?

1 [0,+∞[(x). Ici,svaut 1,η1(θ) = 1/θ,T1(x) =x,B(θ) = logθeth(x) =1[0,+∞[(x). •Loi binomiale :P(X=x|θ) =Cxnθx(1-θ)n-x

=Cxnexp{xlogθ+ (n-x)log(1-θ)} =Cxnexp{xlog[θ/(1-θ)] +nlog(1-θ)} On as= 1,η1(θ) = log(θ/(1-θ)),T1(x) =x,B(θ) =nlog(1-θ)eth(x) =Cxn. 12M1 ISDStatistique Bayésienne

•Loi Gammaf(x|α,β) = (βα/Γ(α))xα-1e-βx. En remarquant que :xα-1e-βx= exp{-βx+ (α-1)logx}ets= 2, on peut écrire :1(α,β) =-β,η2(α,β) =α-1,T1(x) =x,T2(x) = logx,B(α,β) = log(Γ(α)/βα.

Il est classique d"écrire le modèle exponentiel sous la forme ditecanoniqueen reparamétrisant :

i(θ)≡θi. f(x|θ) = exp? s? i=1θ iTi(x)-A(θ)? h(x).On a le résultat suivant qui donne la forme deslois naturelles conjuguéesdans le cas du modèle

exponentiel. Proposition 4- Soitf(x|θ)appartenant à une famille exponentielle. Alors une famille de loi a priori conjuguée pourf(x|θ)est donnée par : π(θ|μ,λ) =K(μ,λ)exp(θμ-λA(θ)) oùK(μ,λ)est une constante de normalisation.Et la loi a posteriori est de la forme :

π(θ|x)?exp((μ+x)θ-(λ+ 1)A(θ)).

Exemple :Considérons le modèle :

P(X=x) =e(θ-β)x

1 +eθ-β, x? {0,1}.

Il s"agit d"une loi logistique. Elle appartient bien à la famille exponentielle.On a :

P(X=x) = exp[(θ-β)x-log(1 +eθ-β)]

et la représentation :h(x) = 1,θ= [θ β]?,T(x) = [x-x]? etA(θ,β) = log(1 +eθ-β). En appliquant le théorème, on obtient une loi a priori de la forme : π(θ,β|μ1,μ2,λ)?exp{[θ β][μ1μ2]?-λA(θ,β)] =eμ1θ+μ2β

(1 +eθ-β)λ. On remarquera que cette loi est impropre. La loi a posteriori aura la forme suivante :π(θ,β|x)?e(μ

1+x)θ+(μ2+x)β

(1 +eθ-β)λ+1. 13M1 ISDStatistique Bayésienne

Proposition 5- Soitf(x|θ)appartenant à une famille exponentielle. Siθ≂exp{θx0-λA(θ)}, x0?X,

Alors Eπ(μ(θ)) =Eπ[?A(θ)] =x0

oùμ(θ)est la moyenne def(x|θ).Six1,x2,···,xniid de loif(x|θ),

Eπ(μ(θ)|x1,···,xn) =x0+n¯x

λ+n.

La preuve de ce théorème s"appuie sur les propriétés de l"emv.4.3 Lois impropres

La loi a priori peut être impropre i.e.?

π(θ)dθ= +∞. Ce choix de type de loi n"a doncplus d"intérêt que calculatoire et s"interprète difficilement. Nous verrons par la suite que la

construction de lois non informative peut conduire à des lois a priori de ce type.Exemple :Considérons la loi1R

+(x), loi uniforme surR+. Supposonsf(x|λ) =λexp{-λx}. La loi a posteriori est :π(λ|x) =λexp{-λx}/?+∞0λe-λx.

Le dénominateur est égal àΓ(2)/x2d"oùπ(λ|x) = [x2/Γ(2)]λexp{-λx}, une loi gamma de

paramètre(2,x).4.4 Lois non informatives

Une loi non informative est une loi qui porte une information sur le paramètre à estimerdont le poids dans l"inférence est réduit. Certains auteurs la définissent également comme une

loi a priori qui ne contient aucune information surθou encore comme une loi qui ne donne pas davantage de poids à telle ou telle valeur du paramètre. Par exemple, supposonsΘun ensemble fini de tailleq, une loi a priori non informative pourraêtre une loi de la forme :

P(θi) = 1/q.

On a équiprobabilité, les valeurs possibles deθse voit attribuer le même poids. La règle de Jeffreys- Une méthode proposée par Jeffreys (1961) permet de fabriquer deslois a priori non informative. Cette méthode utilise l"information de Fischer :I(θ). L"argument

pourrait être le suivant.I(θ)représente une mesure de la quantité d"information surθcontenue

dans l"observation. PlusI(θ)est grande, plus l"observation apporte de l"information. Il semble alors naturel de favoriser (au sens rendre plus probable suivantπ(θ)), les valeurs deθpourlesquelsI(θ)est grande; ce qui minimise l"influence de la loi a priori au profit de l"observation.

14M1 ISDStatistique Bayésienne

Le choix de ce type de loi conduit ainsi souvent à des estimateurs classiques du type maximum de vraisemblance. La règle de Jeffreys consiste donc à considérer des lois a priori de la forme :π(θ) =C?

I(θ) o`uI(θ) =E?

-∂2∂θ2logf(x|θ)? dans le cas unidimensionnel. Rappels sur l"information de Fisher -Soit unn-échantillon(X1,···,Xn)de loif(x|θ).On a le résultat suivant. Sous certaines conditions de régularité, l"estimateur du maximum de

vraisemblance ˆθndeθest tel que, pournassez grand,⎷ n(ˆθ-θ)suit une loi normale centrée, de variance1/I(θ). Autre résultat important : l"inégalité de Cràmer-Rao.Soittn, un estimateur deg(θ), alors :

E(tn-g(θ))2≥(g?(θ) +b?

n(θ))2 nI(θ), oùbn(θ) =E(tn)-g(θ), est le biais. Sig(θ) =θet si l"estimateur est sans biais, on a :V ar(tn)≥1

nI(θ). Ces résultats illustrent l"idée que l"information de Fisher se compare à une variance. Exemple :Soitf(x|θ) =λexp{-λx}1[0,+∞[(x). On calcule l"information de Fischer : ∂λlogf(x|λ) =1λ-x,∂2∂λ2logf(x|λ) =-1λ2 d"oùπ(λ)?1/λ. Ce type de construction conduit très souvent à des lois impropres, des lois telles que :π(θ)dθ= +∞.

On appelle également ces lois desquasi a priori. Remarquons que l"on peut normaliser ces lois (à condition de se donner de l"information surθ, ce qui est, dans ce cadre non informatif, certes paradoxale). 15M1 ISDStatistique Bayésienne

Exemple (suite) :π(λ)?1/λ, si on prendλ?[a,b]; on chercheCtel que :C? b aπ(θ)dθ= 1

et b a1/λdλ= logb-loga.

Ainsi, on pourra prendre :π(λ) = [log(b/a)]-11[a,b](λ).Dans le cas multidimensionnel,θ= (θ1,···,θq), on peut considérer des lois de la forme :

π(θ) = [d´etI(θ)]1/2

oùI(θ)est la matrice d"information de Fischer :I(θ)|i,j=E?

-∂2 ∂θi∂θjlogf(x|θ)? Remarquons que dans le cadre de la théorie du maximum de vraisemblance, le déterminant de cette quantité représente ce qu"on appelle la variance généralisée. Exemple :Dans le cas de la loi de Gauss de paramètres(θ,σ2), f(x|θ,σ2)?1σexp?

-(x-θ)22σ2?On a :

logf(x|θ,σ2)? -12logσ2-(x-θ)22σ2

∂θlogf(x|θ,σ2) =(x-θ)σ2 2 ∂θ2logf(x|θ,σ2) =-1σ2 2 ∂θ∂σ2logf(x|θ,σ2) =-(x-θ)2(σ2)2 ∂σ2logf(x|θ,σ2) =-12σ2+(x-θ)22(σ2)2 2 ∂(σ2)2logf(x|θ,σ2) =12(σ2)2-(x-θ)2(σ2)3La matrice d"information de Fisher s"obtient en calculant, l"espérance mathématique des dérivées

secondes.E(x-θ) = 0etE[(x-θ)2] =σ2.On a donc :

I(θ,σ2) =(

(1/σ200 1/2σ2)

Un loi informative est donc de la forme :π(θ)?1/σ2. 16quotesdbs_dbs33.pdfusesText_39[PDF] fonction rationnelle ensemble de définition

[PDF] fonction rationnelle domaine de définition

[PDF] dérivée de ln lnx

[PDF] primitive de x

[PDF] primitive de x^2

[PDF] dérivées successives exercices corrigés

[PDF] dérivée successive

[PDF] dérivées n-ièmes usuelles

[PDF] dérivée nième de sin

[PDF] dérivée nième polynome

[PDF] dérivée n-ième d'une fonction

[PDF] dérivée nième de cos^3

[PDF] derivee nieme de cos(ax)

[PDF] dérivées partielles exercices corrigés